1. 서론

AI 산업의 다음 무대는 단순한 질문-응답을 넘어선 **'에이전트화(Agentization)'**다. 에이전트는 단순히 답하는 도구가 아니라, 사용자와 장기적으로 협력하고 스스로 학습해 성장하는 **'동반자 AI'**를 지향한다. 이 과정에서 가장 중요한 키워드가 바로 **메모리(memory)**다.

최근 중국의 메이저 기업들이 연달아 새로운 메모리 기술을 발표했다.

알리바바는 대화형 에이전트를 위한 RAISE(Reasoning and Acting through Scratchpad and Examples) 아키텍처를 통해 인간의 단기·장기 메모리를 모방한 시스템을 개발했고,

화웨이는 384개의 NPU를 통합한 CloudMatrix384 인프라로 대규모 분산 메모리 관리의 새로운 표준을 제시했다.

두 연구는 중국식 AI 전략의 방향성을 잘 보여준다. 단순히 더 큰 모델을 만드는 게 아니라, **"기억을 가진 에이전트"**로 차별화를 꾀하는 것이다.

2. 알리바바 – RAISE: 이중 메모리 시스템의 혁신

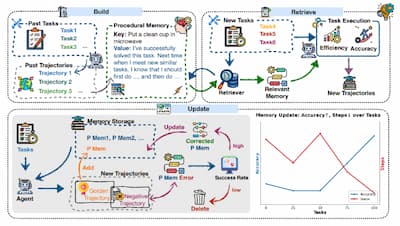

알리바바 연구팀이 개발한 RAISE(Reasoning and Acting through Scratchpad and Examples) 아키텍처는 대화형 에이전트에서 GPT-4와 같은 대형 언어 모델의 통합을 혁신적으로 향상시킨다.

이 시스템의 핵심은 인간 뇌의 단기 및 장기 메모리 기능을 모방한 이중 컴포넌트 메모리 시스템에 있다.

2.1 작동 방식

Scratchpad 컴포넌트는 최근 상호작용에서 핵심 정보와 결론을 캡처하고 처리하는 일시적 저장소 역할을 한다. 마치 인간의 단기 메모리처럼, 현재 진행 중인 대화의 맥락과 중요한 배경 정보를 실시간으로 관리한다.

**검색 모듈(Retrieval Module)**은 에이전트의 장기 메모리로 작동하여, 현재 대화 맥락과 관련된 예시를 소싱하고 통합한다. 이는 과거의 성공적인 대화 패턴과 해결책을 기반으로 현재 상황에 최적화된 응답을 생성할 수 있게 한다.

2.2 구체적인 메모리 구조

RAISE의 메모리 시스템은 네 가지 핵심 구성 요소로 이루어져 있다:

- 시스템 프롬프트: 역할 정체성, 목표, 행동 양식을 포함한 프로필과 태스크 지침

- 컨텍스트: 모든 질의-응답 쌍을 기록하는 대화 기록과 의사결정 궤적

- 스크래치패드: 추론으로 생성된 배경 정보와 지식, 이전 도구 사용 관찰 결과

- 예시(Examples): 모델과 도구의 지식 격차를 보완하고 에이전트 행동을 맞춤화하는 질의-응답 쌍

2.3 효과와 성과

알리바바의 실험 결과, RAISE 아키텍처는 부동산 판매 상담이라는 복잡한 멀티턴 대화 환경에서 기존의 ReAct 프레임워크를 크게 앞선 성능을 보였다. 특히 세밀함(Specificity), 사실 정확성(Factuality), 일관성(Coherence), 자연스러움(Naturalness) 모든 지표에서 향상된 결과를 달성했다.

더욱 중요한 것은 파인튜닝을 통한 성능 개선이다.

단순한 프롬프트 기반 접근법 대비, 고품질 데이터셋으로 파인튜닝된 모델은 전체 품질 점수 7.71점을 달성하며, 추론 효율성까지 최적화했다.

2.4 한계와 과제

하지만 RAISE도 완벽하지 않다. 초기에는 충분한 예시 데이터가 부족해 효과가 제한적일 수 있으며, 메모리 검색과 컨텍스트 관리 비용이 증가할 위험이 있다. 또한 복잡한 논리 문제 처리와 환각(hallucination) 문제에 대한 추가 연구가 필요한 상황이다.

3. 화웨이 – CloudMatrix384: 대규모 분산 메모리의 혁명

화웨이가 2025년 6월 arXiv에 발표한 CloudMatrix384 시스템은 대형 언어 모델 서빙을 위한 차세대 AI 데이터센터 아키텍처를 제시한다. 이 시스템은 384개의 Ascend 910 NPU와 192개의 Kunpeng CPU를 통합하여, 전례 없는 규모의 분산 메모리 관리를 실현한다.

3.1 핵심 기술적 혁신

Unified Bus(UB) 네트워크를 통해 모든 프로세싱 유닛 간 직접적인 all-to-all 통신을 지원하며, 리소스의 동적 풀링을 가능하게 한다. 이는 특히 대규모 전문가 혼합(MoE) 모델의 전문가 병렬처리와 분산 키-값 캐시 액세스 같은 통신 집약적 작업에 최적화되어 있다.

CloudMatrix-Infer라는 고급 LLM 서빙 솔루션은 세 가지 핵심 혁신을 포함한다: prefill, decode, 캐싱을 독립적으로 확장하는 peer-to-peer 서빙 아키텍처, 효율적인 UB 기반 토큰 디스패치를 통한 EP320을 지원하는 대규모 전문가 병렬처리 전략, 그리고 전용 연산자, 마이크로배치 기반 파이프라이닝, INT8 양자화를 포함한 하드웨어 인식 최적화다.

3.2 성능 혁신

DeepSeek-R1 모델을 사용한 평가에서 CloudMatrix-Infer는 최첨단 효율성을 달성했다.

NPU당 prefill 처리량 6,688 토큰/초, decode 처리량 1,943 토큰/초(50ms TPOT 미만)를 기록했다. 특히 인상적인 것은 15ms라는 엄격한 지연 시간 제약 하에서도 NPU당 538 토큰/초를 유지했다는 점이다.

3.3 메모리 아키텍처의 혁신

화웨이의 접근법은 단순한 하드웨어 확장을 넘어선다. 동적 리소스 풀링을 통해 메모리 대역폭, 칩 간 통신, 지연 시간이라는 AI 인프라의 근본적 한계를 해결한다. 이는 가변적인 워크로드와 엄격한 서비스 수준 목표를 동시에 만족시키는 혁신적 해결책이다.

3.4 산업적 의미

화웨이의 CloudMatrix384는 단순한 기술적 성취를 넘어 중국의 AI 하드웨어 자립 전략의 핵심을 보여준다. 미국의 제재로 인한 고성능 메모리 칩 공급 제한 상황에서, 자체 개발한 Ascend NPU와 혁신적 아키텍처로 경쟁력을 확보했다는 점에서 전략적 가치가 크다.

4. 공통되는 혁신과 도전

4.1 혁신적 장점

지속성: 두 시스템 모두 세션이 끊겨도 경험과 학습을 이어받을 수 있는 지속적 메모리를 제공한다. 알리바바의 RAISE는 대화 히스토리와 태스크 궤적을 통해, 화웨이의 CloudMatrix는 분산 키-값 캐시를 통해 이를 실현한다.

효율성: 시행착오를 줄이고 토큰 및 추론 비용을 대폭 절감한다. RAISE의 예시 기반 학습과 CloudMatrix의 하드웨어 최적화는 각각 소프트웨어와 하드웨어 차원에서 효율성을 극대화한다.

적응성: 새로운 환경과 도메인에서도 유연하게 대응할 수 있다. 두 시스템 모두 동적 확장과 실시간 최적화를 지원한다.

확장성: 알리바바의 절차적 지식은 대형 모델에서 소형 모델로 전이가 가능하며, 화웨이의 아키텍처는 수백 개의 NPU로 선형 확장이 가능하다.

4.2 공통적 과제

복잡성 증가: 메모리 검색, 계획, 업데이트 등으로 시스템 복잡도가 급격히 증가한다. 이는 잠재적 지연과 오류 발생 가능성을 높인다.

메모리 관리의 딜레마: 무엇을 기억하고 무엇을 잊을지에 대한 명확한 기준이 없으면, 오히려 성능 저하를 초래할 수 있다.

프라이버시와 보안: 메모리가 곧 사용자 데이터의 총체라는 점에서, 개인정보 보호와 데이터 오남용에 대한 우려가 커진다.

신뢰성 문제: 저장된 메모리나 학습된 패턴이 왜곡되거나 조작될 경우, 전체 시스템의 신뢰성이 크게 훼손될 수 있다.

5. 전략적 관점에서 본 평가

5.1 긍정적 전망

사용자 경험의 혁신: 개인화되고 지속적으로 학습하는 AI 경험을 제공함으로써, 기존 AI 서비스와는 차원이 다른 가치를 창출한다.

비용 효율성: 하드웨어 최적화와 소프트웨어 지능화를 통해 동일한 성능을 더 적은 비용으로 달성할 수 있다.

차별화 전략: 단순한 모델 크기 경쟁에서 벗어나 실용적 가치에 집중한 전략적 우위를 확보한다.

5.2 우려와 위험

감시 사회로의 전환: 특히 중국 내에서 이러한 메모리 기술이 사회적 통제와 감시 도구로 악용될 가능성이 존재한다.

글로벌 신뢰성 한계: 유럽과 미국의 엄격한 개인정보 보호 규제 하에서는 이러한 기술의 확산이 제한될 수 있다.

기술적 복잡성: 메모리 유지와 관리 자체가 새로운 기술적, 경제적 부담으로 작용할 위험이 있다.

6. 결론 : 중국의 전략적 선택과 한국의 딜레마

중국의 알리바바와 화웨이는 AI 경쟁에서 단순히 **"더 큰 모델"**로는 미국 빅테크를 따라잡기 어렵다는 현실을 정확히 인식하고 있다. 그래서 선택한 길이 바로 **"메모리 부여형 에이전트"**다. 이는 비용, 정책, 생태계 삼박자에 맞춘 영리한 전략이다.

알리바바의 RAISE 아키텍처는 소프트웨어적 혁신을 통해 기존 하드웨어에서도 뛰어난 성능을 달성할 수 있음을 보여준다. 한편 화웨이의 CloudMatrix384는 자체 하드웨어 생태계를 기반으로 한 수직 통합의 힘을 입증한다. 두 접근법 모두 미국의 기술 제재라는 제약 조건 하에서 독자적 경쟁력을 확보하려는 중국의 전략적 의지를 반영한다.

하지만 한국의 현실은 다르다. 미국처럼 초거대 모델을 만들 자본과 인프라도 없고, 중국처럼 내수 시장과 정책적 드라이브로 밀어붙일 힘도 부족하다. 결국 "이도저도 아닌" 전략 속에서, 국내 AI는 여전히 후발 주자도, 독자 노선도 아닌 어정쩡한 길을 걷고 있다.

AI 산업은 더 이상 연구실의 과제가 아니다. 메모리를 가진 에이전트는 이미 산업과 생활 속으로 들어오고 있다. 알리바바와 화웨이의 연구가 보여주는 것처럼, **"AI를 어떻게 기억하게 만들 것인가"**라는 질문에 대한 답을 찾지 못한다면, 한국은 곧 "AI를 개발하는 나라"와 "AI를 소비만 하는 나라" 사이의 돌이킬 수 없는 간극에 서게 될 것이다.

결국 메모리를 가진 AI 에이전트는 단순한 기술적 진보가 아니라, 미래 디지털 경쟁력을 좌우할 전략적 분기점이다. 중국이 선택한 길이 정답인지는 시간이 말해주겠지만, 적어도 그들은 명확한 방향성을 가지고 전진하고 있다는 점에서 주목할 만하다.

참고 논문:

- 알리바바: "From LLM to Conversational Agent: A Memory Enhanced Architecture with Fine-Tuning of Large Language Models" (arXiv:2401.02777v1, 2024년 1월)

- 화웨이: "Serving Large Language Models on Huawei CloudMatrix384" (arXiv:2506.12708, 2025년 6월)

'🤖 AI와의 대화' 카테고리의 다른 글

| 생성에서 검증으로 : 오픈AI의 범용 검증기 (Universal Verifier)시대의 개막 (2) | 2025.09.23 |

|---|---|

| 클로드의 가장 비윤리적 아이러니 : 지식의 생태계를 위한 크롤링과 트래픽 환원 문제 (6) | 2025.09.19 |

| 샘 알트만의 이례적인 언급 : OpenAI의 운명을 쥔 야쿠브와 시몬 (0) | 2025.09.09 |

| 머스크가 던진 반독점 카드, AI 판을 흔들다 : xAI & 애플, 오픈AI 소송전 (14) | 2025.08.26 |

| 철학적 좀비가 현실이 되는 순간 : SCAI 시대의 건전한 인간-기계 관계 (8) | 2025.08.22 |